一文梳理图上的点击率预测模型

作者简介:田震,研究方向为推荐系统。

1 . 引言

图神经网络凭借其强大的泛化能力在计算机视觉与自然语言处理等领域取得了出色进展。为了解决点击率预测任务中面临的特征数据稀疏、泛化能力差等问题,不少工作使用图神经网络学习模型中特征之间的关系,以及进行特征交互建模。笔者整理了近年来利用图神经网络进行点击率预测的工作,这些工作在特征交互建模以及用户行为挖掘等方面取得了不错效果。欢迎大家批评指正,相互交流。

2. 论文解读

1. Explicit Semantic Cross Feature Learning via Pre-trained Graph Neural Networks for CTR Prediction. (SIGIR 2021)

本文来自于阿里,作者主要提出了一种利用GNN进行显式交互统计建模的方法。目前CTR领域大多数工作都聚焦于隐式特征交互,而利用显式交互统计特征进行建模的工作较少。进行显式统计特征建模面临的问题主要有:泛化能力不强,无法提取交互历史没有出现过的特征组合;计算资源代价较大,对于显式统计特征,通常需要维护一张不同特征组合笛卡尔积的存储表,需要巨额存储开销。为了解决这个问题,作者利用GNN引入了显式交互统计特征学习的预训练任务。

如图所示,作者首先根据历史交互记录构建后验特征交互图。图顶点代表特征,即user、item、shop。边为不同组合特征对应的显式交互统计特征,其计算公式为: a_{u,i} = \frac{Count(u,i)|(click=1)}{Count(u,i)} 。

GNN预训练过程如图所示,整体流程与GraphSAGE相同,分为邻居结点聚合以及结点表征融合两个过程。邻居结点聚合过程采用multi-relation based aggregation function考虑不同结点之间的关系,在得到邻居节点聚合信息后融合自身上一时刻的表征,最终输出每个结点最后时刻的状态向量 h_i^{K} 。得到不同结点表征之后,作者通过CrossNet预测连接边的属性 p_{u,v} = CrossNet(h_{u}^{(K)},h_v^{(K)}) 。最终,作者引入对数平滑下的共现值区分不同交叉特征的重要性: loss = \sum_{e_{u,v}}log(Count(u,v) + t)||p_{u,v} - a_{u,v}||^2 。

2. Dual Graph enhanced Embedding Neural Network for CTR Prediction. (KDD 2021)

本文来自于华为,主要探索CTR任务中特征交互引起的特征稀疏性与行为稀疏性的解决方案,主要采用分治法和课程学习的思路结合GNN进行特征表示学习。

如图所示,DG-ENN首先通过属性图卷积以及协同图卷积学习特征的最佳表示,然后将其应用到下游的CTR任务中。在属性图卷积过程,作者主要构造了两种类型的属性图,分别是用户图 \mathcal{G}_{ua} =<\mathcal{U} \cup\mathcal{A},\mathcal{E}_{ua}> 以及物品图 \mathcal{G}_{vb} = <\mathcal{V}\cup\mathcal{B},\mathcal{E}_{vb}> ,不同类型的属性图描述了用户/物品与其属性之间的关系。之后,作者采用了GCN,NGCF以及LightGCN等三种常见方法进行邻域聚合和表征融合,输出不同结点的最终表示 \hat{e}_{h} 。最后,作者进行了跨域信息整合,得到用户和物品的最终表示: z_{u}=\sum_{t=1}^{J}\hat{e}_u^{(t)},z_{v}=\sum_{t=1}^K\hat{e}_v^{(t)} 。

在协同图卷积过程,作者利用用户与物品间的协同信号缓解了用户行为序列面临的稀疏性问题。用户-物品的协同图可以表示为一个二分图 \mathcal{G}_{uv}=<\mathcal{U}\cup\mathcal{V},\mathcal{E}_{uv}> ,其中图中的边描述了用户和物品的交互行为。除了构建用户-物品图外,作者还引入了用户-用户图以及物品-物品图。其中,用户-用户图采用相似度决定其中节点间的连接关系,计算公式为: sim(i,j) = \alpha_1\frac{<Y_i,Y_j>}{||Y_i||\cdot||Y_j||}+\alpha_2\frac{<A_i,A_j>}{||A_i||\cdot||A_j||} ,式中 Y 表示用户交互过的物品,即交互矩阵中的行,因此第一部分描述了不同用户偏好的相似性; A 表示用户属性,因此第二部分描述了用户画像的相似性。得到不同用户顶点间的相似度后,作者采用K近邻确定不同用户的邻居节点。物品-物品图的构建比较简单,直接基于用户的交互行为序列,即用户连续交互的两个物品之间存在连边。因此,最终的协同图可以表示为 \mathcal{G}_{cf}=<\mathcal{U}\cup\mathcal{V},\mathcal{E}_{uu}\cup\mathcal{E}_{uv}\cup\mathcal{E}_{vv}> 。协作图卷积过程与之前类似,不同的是其原始特征为属性图卷积学习到的特征表示,然后先通过用户-用户图以及物品-物品图学习用户和物品的表征,再进行用户-物品间的信息传播。最终,得到下游CTR预测任务的特征: P=[\hat{p}_u,\hat{p}_v,z_{A_u},z_{B_v},\hat{p}_{S_u},e_c] 。

3. Graph Intention Network for Click-through Rate Prediction in Sponsored Search. (SIGIR 2019)

本文来自阿里,主要利用图神经网络进行用户兴趣挖掘,其动机源于已有用户意图模型面临的行为稀疏性问题以及泛化能力弱等问题。其主要创新点在于构造出了一种商品共现图,并基于此提出了图意图网络,利用多层图聚合挖掘用户意图。

商品共现图的构造过程如上图所示,其中作者首先根据查询的相似度将用户的历史行为序列分割为不同的会话,然后对每个会话中的商品使用滑动窗口添加无向边,因此共现图中的边权重代表了不同商品对出现的次数。

如图所示为图意向传播和聚合的过程,首先作者根据用户行为序列的商品按层进行搜索,探索与当前序列共现关系强的商品。之后,从最外层开始逐层进行邻域聚合,最终学习到序列中每个商品的用户意图向量 h_c^{(K)} 。最后,利用注意力机制获得用户潜在偏好向量: a_c = softmax(score(h_{ad},h_c^{(K)})), uii=\sum_{c}{a_c}h_c^{(K)} 。整体CTR预测过程呈现一种端到端的联合训练方式,得到用户偏好向量后,将其与用户特征、商品特征以及上下文特征进行拼接,通过MLP进行特征交互建模,得到最终预测的CTR值。

4. Masked Transformer for Neighhourhood-aware Click-Through Rate Prediction. (SIGIR 2022)

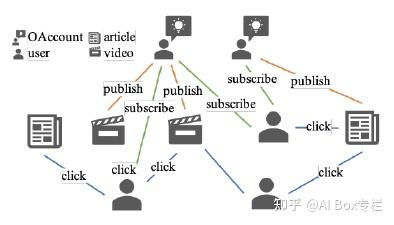

本文来自于腾讯,主要利用图神经网络增加用户和商品的表征。作者首先指出,目前推荐系统的性能受限于用户的行为分布以及系统曝光,这些因素导致模型提取到的特征信息量不足,从而导致预测的准确率下降。为了解决这个问题,作者提出了异构信息网络HIN,通过构造节点之间的不同拓扑交互结构来增强提取的特征信息。

其中微信视频推荐场景的异构图如图所示。其节点有用户、视频、文章以及公众号四种类型。其边有用户-<点击>-视频,用户-<点击>-文章,用户-<订阅>-公众号,公众号-<发布>-视频以及公众号-<发布>-文章五种类型。异构图可形式化表述为 \mathcal{G} = (\mathcal{N},\mathcal{E},\mathcal{T}_{\mathcal{V}},\mathcal{T}_{\mathcal{E}}) ,其中 \mathcal{T}_{\mathcal{V}},\mathcal{T}_{\mathcal{E}} 分别表示节点类型的集合以及边类型的集合。

HIN的结构如图所示。作者首先提出了一种贪心领域采样算法选取图结点,其主要思想是尽可能多地对低阶邻居进行采样,对每类结点均采取一定数量,并且尽可能多地选取与其它结点连接比较多的节点。对于用户 u 以及物品 v ,其贪心领域采样算法选取的邻居节点表示为 N_{uv} 。为了丰富不同节点的表征,作者构造了四种类型的交互图,分别为:诱导子图:直接采用原始异构图中不同节点之间的链接关系;相似度子图:首先计算邻域内节点的特征embedding的余弦相似度,然后直接以相似度分数作为边权重或者采用K近邻算法确定不同节点的链接关系;交叉领域子图:以用户 u 的邻居 N_u 和物品 v 的邻居 N_{v} 构造完全二分图。完全子图:即构造所有邻居节点的完全图。最终,一个样本实例可以表示为 \{\mathcal{F}_{uv},\mathcal{G}_{\mathcal{I}},\mathcal{G}_{\mathcal{S}},\mathcal{G}_{\mathcal{C}},\mathcal{G}_{\mathcal{P}} \} 。

最后作者根据构造的四种子图构造图掩码transformer,其注意力分数为e_{ij} = f_m(\frac{(Qh_i)^T(Kh_j)}{\sqrt{d}},M_{ij}) 。其中 f_m(x,\lambda)= \Big\{ \matrix{\lambda x && \lambda \neq 0 \\ -\infty && \lambda = 0} 为掩码函数,同时作者将注意力头分成四组,每组共享一个子图的邻接矩阵 M 。最终,将所有邻居的表示后进行平均池化得到信息增强的邻域表征,并和用户特征、商品特征以及上下文特征拼接后用于最终的CTR预测。

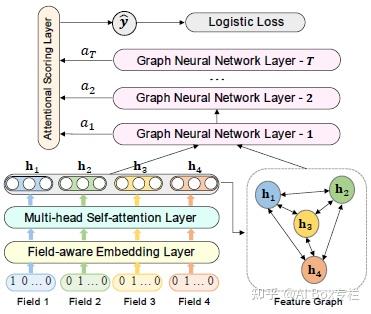

5. Fi-GNN: Modeling Feature Interactions via Graph Neural Networks for CTR Prediction.(CIKM 2019)

本文主要利用图神经网络进行端到端地隐式特征交互建模。作者首先指出目前大部分工作在进行特征交互建模时简单地将特征域进行非结构化地结合,这种做法不可避免地会限制模型的能力。为了灵活地捕捉不同特征域的特征交互,作者将所有特征域建模为特征图,利用图信息传递建模高阶特征交互。

模型的整体结构如图所示,作者首先将所有特征构建为一个特征图 \mathcal{G} = (\mathcal{N},\mathcal{E}) 。其中图中的每个节点表示为一个特征域,不同特征域可以通过带权边进行交互。

边的权重采用注意力机制计算: w(n_i,n_j)=\frac{exp(LeakyReLu(W_w[e_i || e_j]))}{\sum_{k}exp(LeakyReLu(W_w[e_i || e_k])}

其中特征图的拓扑结构为全连接结构,即图的邻接矩阵可以表示为 A[n_i,n_j]= \Big\{ \matrix{w(n_i,n_j) && i \neq j \\ 0 && i=j}

每个时刻,通过邻域聚合更新自身节点表征: a_i^t = \sum_{n_j \rightarrow n_i \in \mathcal{E}}{A[n_j,n_i]W_ph_j^{t-1}} 。

图交互过程如上图所示。为了减少计算复杂度,作者首先将聚合矩阵进行分解: W_p^{n_i \rightarrow n_j}=W_{out}^{i} W_{in}^j ,通过这种分解,特征可以进行Edge-wise的交互过程。

同时,作者沿用了GGNN的消息传递机制,其表征融合过程为: h_i^t=GRU(h_i^{t-1},a_i^{t}) 。

最后,采用注意力机制计算CTR: \hat{y_i} = MLP_1(h_i^p) ,a_i = MLP_2(h_i^p),\hat{y} = \sum_{i=1}^M a_i \hat{y_i} 。

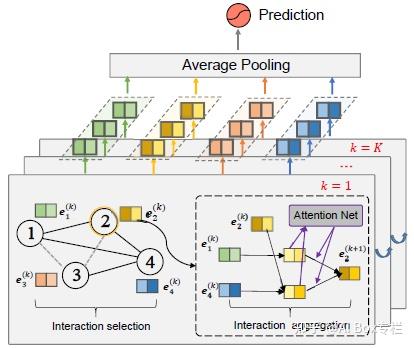

6. GraphFM: Graph Factorization Machines for Feature Interaction Modeling. (arXiv)

本文是Fi-GNN作者提出的利用图神经网络进行特征交互建模的又一力作。作者首先指出了目前的因子分解机模型存在无法有效捕获高阶特征交互并且枚举无效交互引入噪声的缺点。为了构造高阶特征交互的同时过滤无效交互,作者采用交互选择-交互聚合两阶段的方式进行特征交互建模。

模型结构如图所示,整体可以分为交互选择以及交互聚合两个过程,在交互选择过程确定图的拓扑结构构图,然后利用图聚合进行特征交互。

作者首先采用MLP量化不同节点之间的重要程度: f_s(e_i,e_j)=\sigma(W_2^s\delta(W_1^s(e_i \odot e_j)+b_1^s)+b_2^s) ,得到初始化邻接矩阵 P^{(k)} 。同时,作者给出了交互选择过程的伪代码:

for \ i=1,2,...,n\\ \quad \quad \quad \quad \quad \quad idx_i = argtop_{m_k}(P^{(k)}[i,:]) \\ \quad \quad P^{(k)}[i,-idx]=0

即在交互选择过程中只保留前 m_k 个邻居特征,同时作者在实验中探究了不同特征域数量下的最优 m_k 值。在交互选择阶段后,每个节点的邻居可以表示为:\mathcal{N}_i^{(k)}=\{v_j|p_{ij}^{(k)}>0,j=1,2,...,n\} 。

在交互聚合过程,作者引入软注意力机制计算交互权重: c_{ij}=LeakyReLU(a^T(e_i \odot e_j)) 。

并使用softmax对权重系数标准化: \alpha_{ij} = \frac{exp(c_{ij})}{\sum_{j'\in \mathcal{N}_i}exp(c_{ij'})} 。

聚合过程同时结合交互选择过程的硬注意力权重控制交互信息: e_i' = \sigma(\sum_{j \in \mathcal{N}_i}\alpha_{ij}p_{ij}W_{\alpha}(e_i \odot e_j)) 。

最终根据所有节点的信息计算CTR: e_i^*=e_i^{(1)} || ...||e_i^{(K)}, e^*=\frac{1}{n} \sum_{i=1}^n e_i^*, \hat{y}=p^Te^* 。

3.小结

本文总结了近年来利用图神经网络进行点击率预测的工作。大部分工作主要利用图神经网络优化特征工程,增强特征表示,能够有效地解决特征建模面临的特征稀疏以及泛化能力不强等问题。同时也有一部分工作尝试利用图神经网络建模特征交互,能够更加方便地集成到现有的精排模型中。然而,大部分图神经网络工作需要进行全局的非端到端建模,计算复杂度较高。如何设计轻量级且易部署的图模型仍是一个值得探索的课题。

扫描下方二维码关注AI Box,获取更多AI资讯